Denne forfatter knækker Technocrat-sammensværgelsen om at bruge FDA til at institutionalisere transhumanisme. Fremtidige test af lægemidler og terapier vil blive udført på digitale tvillinger eller direkte på mennesker i stedet for dyr. Dette er en markant ændring i sundhed (dis)pleje, som baner vejen for den endeløse brug af EUA til at "godkende" nye lægemidler.

Sundhedssystemer

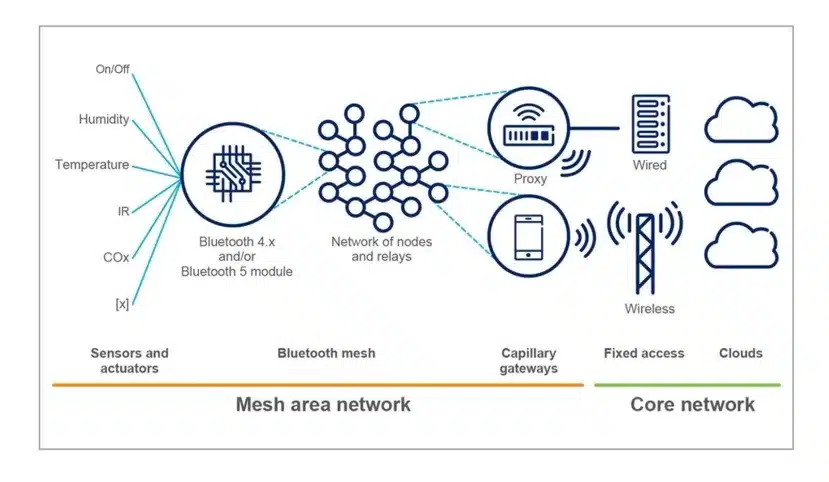

Wearables: Smartphones, fitness-trackere, Smartwatches, høreapparater, Apple Air Tags, Ring-produkter osv., alle bruger Bluetooth LE (lavenergi) til at danne et selvstændigt "mesh-netværk", der ikke er baseret på internettet. Alle disse enheder kan modtage, sende og videresende datapakker og instruktioner til andre enheder. Næsten alle IoT-enheder vil være udstyret med BLE. Dermed er INFRASTRUKTUREN komplet, og venter bare på at sætte tænderne i menneskeheden overalt.

Total Surveillance Society

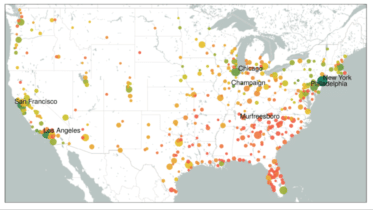

Bevægelsen Universal Basic Income (UBI) er global og bliver skubbet direkte fra toppen af FN, som eksisterer for bæredygtig udvikling, også kendt som Technocracy. I Amerika blev det skubbet af National League of Cities, der hyrder over 2,700 af de største byer. Akademiske institutioner som Stanford University, University of Michigan og Arizona State University presser det hårdt på.

Universal Basic Income

Hall of Shame: Kongressen stemmer for garantiløs overvågning af amerikanere

Teknokrati: "The Science of Social Engineering" og afslutningen på gæld

Flashback 1992: Hvad The Washington Post skrev om Trilateral Commission

Øer, som klimaalarmister sagde, ville snart "forsvinde" på grund af stigende hav, der viste sig at være vokset i størrelse

Droppet uden varsel: Forsikringsselskaber spionerer på huse via luftfotos, søger grunde til at annullere dækning

Trilateral kommissær Larry Summers, OpenAI bestyrelsesmedlem, siger, at alt arbejdskraft vil blive erstattet

Bill Gates & UN bag "Digital Public Infrastructure" for global kontrol

Resultater af dødelige mRNA-vaccineprøver hos svin?

Tennessee Senat siger "Nej" til mRNA-vacciner i mad

teknokrati, Total Surveillance Society

Det australske senat godkender digitalt ID, Amerika er næste

The Fury Of Europe's Farmers Chokerer EU-teknokrater

Seneste daglige podcasts

Climate Change

Øer, som klimaalarmister sagde, ville snart "forsvinde" på grund af stigende hav, der viste sig at være vokset i størrelse

Login Tilmeld dig nu

Det amerikanske oprør mod grøn energi er begyndt

John Podesta: Portræt af en fuldendt teknokrat (og klimazaren)

Forskere: Dit åndedræt er nu en kilde til drivhusgas

Fængselsstraf for operatører af gasdrevne løvblæsere, kantmaskiner, plæneklippere?

teknokrati

Hall Of Shame II: Takket være Kongressen er NSA 'Bare dage fra at overtage internettet'

Login Tilmeld dig nu

Bill Gates & UN bag "Digital Public Infrastructure" for global kontrol

Det australske senat godkender digitalt ID, Amerika er næste

De mest censurerede emner på jorden: Den trilaterale kommission, teknokrati og transhumanisme

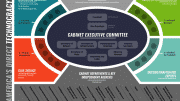

Teknokrati konstruerer AI-drevet kontrolnet for at afslutte friheden

2030 dagsorden

15-minutters by: Denne erklæring bør læses ved hvert byrådsmøde i Amerika

Login Tilmeld dig nu

King Charles planlægger at fremskynde FN's 2030-dagsordensmål og fuldende digitalisering af menneskeheden

FN udvider bemyndigelsen til at håndtere "ekstreme globale chok"

Dutch Farmers Rebel: FN's 2030-dagsorden er bag Draconian AG-nedlukning

Vores fælles dagsorden: "Multilateralisme med tænder"

Bæredygtig udvikling

EU søger regel om at forbyde reparationer på biler ældre end 15 år

Login Tilmeld dig nu